近期,人类会创始人、理事长胡家奇先生,与到访的诺贝尔化学奖得主迈克尔·莱维特教授,举行了以“科技与人类未来”为主题的学术对话,双方就多项议题深入交换了意见。在这场顶尖学者之间的思维碰撞中,我们看到了科学与人文、理性与关怀的交汇。在这个科技加速迭代的时代,人类的命运需要更多仰望星空者去守护。唯有放下分歧,以人类共同利益为出发点,才能实现人类永续与普遍幸福。

以下是胡家奇理事长与莱维特教授的完整对话。为便于观看,内容经过了必要整理,但最大程度保留了双方的原始论述与思维脉络。

一、胡家奇学术理论框架的交流

胡家奇:

教授,我们想分成两个方面来介绍。

第一个,我先把我的一些基本观点和基本研究介绍一下,然后有些问题我们可以进行讨论,有些观点您可能不太同意,不要紧,我们可以讨论,可以交流。

今天的主题是“科技与人类未来:对话诺奖得主迈克尔·莱维特”。

我今天是以人类会创始人、理事长的身份接待您,我想介绍一下我这么多年研究的大致情况。

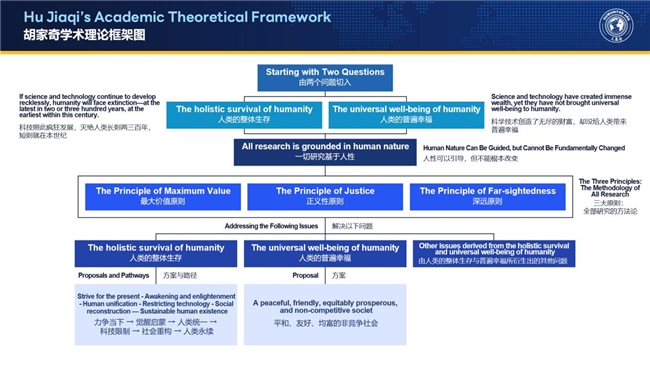

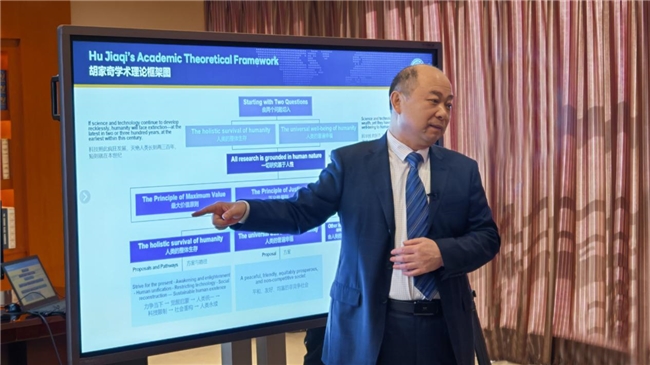

(指着PPT)我的学术理论框架,在这张图中大致能够说明白。

我一生从事人类问题研究,至今已近半个世纪,47年吧。前期我用28年完成了这一部80万字的书《拯救人类》(指着《拯救人类》两卷本的书),这是2007年在中国出版发行的。之后又写了其他的书,发表了一些文章,写了一些信,还有演讲、访谈、视频等,我在涉及人类问题的所有线索都是遵循这一理论框架的。

现在我来介绍这一理论框架。

(指着PPT)我的一切研究是从这两个问题切入的,一个是“人类的整体生存问题”,一个是“人类的普遍幸福”。

因为我觉得这两个问题最大,没有比这两个问题更大的问题了。

对于人类的整体生存问题,我通过严密、系统的论证,得出来了这么一个结论:科学技术照现在现在这么发展下去,长则两三百年,短则本世纪,就可以把人类灭绝。后面有我论证的过程,这个过程我们可以讨论。

就是说科学技术不能像现在这样失控的发展了,这个问题非常严重,我们要解决它。因此,今天我想跟教授主要探讨的就是这个问题。

第二个是人类的普遍幸福问题。科学技术创造了无尽的财富,却没有给人类带来普遍的幸福。这不是我说的,是历史学家说的。

比如斯塔夫里阿诺斯在他的《全球通史》中,就讲到了这个问题:今天我们人类的幸福感还不如旧石器时代刚刚走出山洞的人们。

这是他的书中写的,其他的历史学家也说过类似的观点,他利用的是考古学家的证据,如果将来有机会,我们可以深度探讨这个问题,但今天这不是我们主要讨论的内容。

我全部的研究一切都基于人性。

因为我认为我们人类是一个特定的物种,我们不是神,不是仙,我们就是人类。人性可以引导,但是不能根本改变。任何违背人性的社会制度的设计,我认为它一定会失败。我们可以看到,中国原来就失败过。

那么基于人性,我构建了三大原则:最大价值原则、正义性原则、深远原则。这三大原则,就是我全部研究的方法论。后面有时间的话,我可以介绍这三大原则的具体内容。

在研究的过程中间,我们会发现,如果不认同这三大原则,也许我们的研究结论是错误的结论。因此,首先我们要认可这三大原则的正确性。

那么我构建的这个方法论,最后试图解决三个问题:

第一个问题,就是人类的整体生存问题。

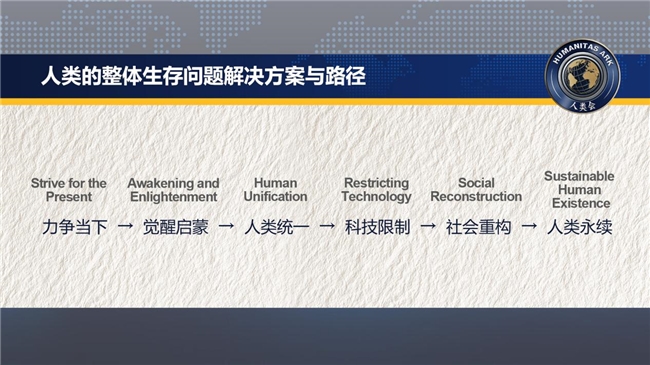

人类整体生存问题的解决方案与途径是什么呢?我在这个地方说了(指 PPT上),科学技术照此发展下去,灭绝人类会很快。我们应该怎么解决这个问题呢?我认为要想根本解决就是要通过人类的大统一,严格的限制科学技术的发展。我们只把那些安全、成熟的科学技术普及到全球。

它实现的路径是什么呢?(指向PPT)

一,要“力争当下”。就是我们在当下,也要采取各种有利于避免科技灾难的工作。比如现在有个“对齐理论”,尤德科夫斯基等人提出的。虽然我觉得作用不大,但多少有一些作用,有比没有好。

二,推动一场“觉醒运动”。就是需要推动一场人类的觉醒运动,我们要重新认识科学技术。

三,通过推动觉醒运动,实现“人类的大统一”。

然后,“严格限制科学技术的发展”。把那些高危科技,尤其是科学理论,要永久封存起来,以致遗忘。

还要,对“社会进行重构”。也就是重新建构我们的社会制度。

从而达到“人类永续”的目的。

这是要解决“人类的整体生存”问题的路径。

第二个问题,是“人类的普遍幸福”问题。

我搭建了这么一个社会架构:要建立一个“平和、友好、均富的非竞争社会”。我认为一个平和、友好、均富的非竞争社会,是最有利于人们普遍幸福感获得的。同时,这样的社会也有利于大统一社会的稳定。

第三个问题(指向PPT),我们还要解决“由人类的整体生存,以及普遍幸福所衍生出来的其他问题”。

这就是我所有的研究,不管是八十万字的《拯救人类》,还是我写的其他书、写的所有的文章,都是在这个大的架构下运行的。

这是我说的第一部分。我介绍了这些以后,教授您有什么问题需要和我交流的吗?

莱维特:

我刚才听了您的介绍之后,已经完全明白了您的观点,虽然里面可能有一些是我不同意的,但是您的观点现在已经明确了。我们可以继续往下走。

二、“三大原则”——胡家奇的方法论交流

胡家奇:

好的。

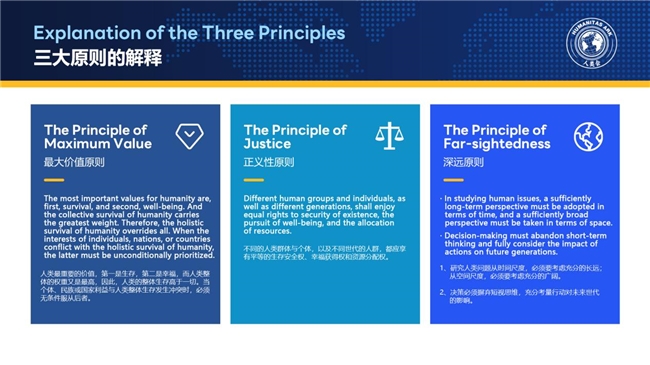

我先把我的方法论简单讲一讲,我的方法论就是“三大原则”。

第一个是“最大价值原则”。

我认为人类最重要的价值,第一是生存,第二是幸福,而人类的整体的权重又是最大的,因此“人类的整体生存高于一切”。当个体、民族或国家利益与人类整体生存发生冲突时,必须无条件的服从后者。

所以,我的理论的重要口号,也是我们人类会最重要的口号,就是:“人类的整体生存高于一切!”

您看我的书的扉页上就写着:“人类的整体生存高于一切!”。假如有人不同意我的这个原则,很有可能我后面的结论就是错误的。

莱维特:

这一点我是同意的。

胡家奇:

好的。

第二个是:“正义性原则”。

正义性原则就是不同的人类群体与个体,以及不同世代的人群,都应该享有平等的生存安全权、幸福获得权、和资源分配权。这是“正义原则”的基本含义。

假如有人认为他一定要有比别人多获得的特权,这就不符合正义性原则。

所以,假如某人不同意“正义性原则”,在他眼里可能我们的很多研究结论刚好相反。

第三个原则是“深远原则”。

深远原则就是研究人类问题从时间的尺度,必须要考虑得充分长远;从空间的角度,必须要考虑得充分广阔。决策必须秉弃短视思维,充分考量行动对未来世代的影响。

这种充分,超出了一般人的想象。因为我们人类这样的一个物种,在世界上生存上亿年都是有可能的。恐龙在地球上生存了1.6亿年,鹦鹉螺在地球上生存了5.3亿年。它之所以生存这么长的时间,是因为它很强大,而我们人类比它们还要强大。如果不站在如此长远的角度上考虑问题,很有可能我们这么强大的人类,最后会自己作死。

所以在我的研究中,我研究的时间尺度,是从宇宙的开始,到宇宙的终结;而空间角度,是从我们的脚下,一直到宇宙的边缘。我的研究就是这么大的视野。

我用这样的视野去研究,不是说我们要到许多亿光年的宇宙边缘干什么去,也不是说我们要到许多亿年后的未来去干什么。恰恰是我们用这样的视野作为参照,来解决我们当下的事情。

所以深远原则不是一个虚无缥缈的、很未来的行动。只是以这样的视野作为一种方法,来研究我们当下要做的事情。

这就是我们建立的三大原则,这三大原则就是我全部研究的方法。

教授您有什么问题,随时可以提出来,或者我讲完以后再提出来。

莱维特:

我现在听得非常明白。

三、科技灭绝人类的论证方法

胡家奇:

那么,下面我想重点跟您讨论的,就是这个问题(指着PPT),现在很多人不能接受的问题:也就是“科学技术的继续发展必定很快灭绝人类,长则两三百年,短则就在本世纪”。

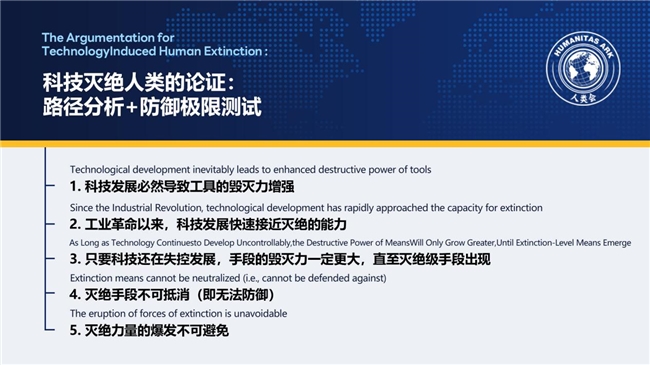

我是怎么论证的呢?就是科技灭绝人类的论证。

我是以路径分析+防御极限测试的方法进行研究的。因为科技能不能灭绝人类,无法证伪,不能重复试验,而且样本也很单一。我们所知道的,也就是我们的地球,还有我们这一个人类。所以很难用别的方式进行论证。

一些科学家用概率的方式去论证,我是不太看好的。我觉得不太科学。

举个简单的例子,人类的整体生存,无与伦比的重要。哪怕灭绝是万分之一的概率,乘上无穷大,还是约等于无穷大,还是不能做。哪怕灭绝是百万分之一的概率,乘上无穷大,还是约等于无穷大。所以我不太欣赏那种用概率的方式去计算科技灭绝人类的问题。

比如牛津大学的托比·奥德,他就认为在一百之年内,科技灭绝人类的概率是六分之一。辛顿,生成式人工智能的重要贡献者,他就认为在四十年之内,生成式人工智能失控的概率有百分之二三十。

对于他所取样本的的科学性,我持怀疑态度。如果真的按照他所取的样本,那么我们今天必须要马上把人工智能停下来。因为奥德的六分之一就是百分之十六,百分之十六乘上无穷大,那还是无穷大。辛顿的百分之二三十,乘上无穷大,还是约等于无穷大。这个事情就是不能做的。所以我认为那个方法不科学。也许我说的不对,这是我的一家之言,这是可以讨论的。

因此,我认为虽然科技灭绝人类无法证伪,也没办法观察,这个实验也不可能重复。但是,灭绝风险是可以部分被验证和评估的。

所以我对人类灭绝的论证过程,是通过灭绝路径分析法,加上防御极限测试的方法,这两个方法结合起来论证的。

整个论证的过程是怎样的呢?我论证的起点在这个地方(指着PPT):

首先,科技发展必然导致工具的毁灭力增强。

比如我们在原始时期,在石器时代,用石头和棍棒去追逐野兽。同时它也作为人类打斗的工具,可是效率很低。

后来进入冷兵器时代,一刀一剑杀伤一个人。

后面发明了火药,有了爆炸弹,一颗炸弹的爆炸,可以杀伤一片。

后面有了质能方程,就有了核武器。核武器爆炸,可以摧毁一座城市。

所以随着科学技术的发展,毁灭力增强,这是一个常识。不需要论证,它是一个历史的常识。

我是分五步论证的,这是第一步。

我的第二步,就是工业革命以来,科技发展快速接近灭绝的能力。

科学技术发展的加速,我认为是从工业革命开始的。工业革命之前,它的发展速度很慢。

那么,科技的加速从十八世纪中叶工业革命开始,是呈指数级的增长。人类只用两百多年的时间,便将科学技术发展到了今天的高度。

刚才说了,核武器已经很厉害了。那么今天有基因工程、有纳米技术、有人工智能。现在很多科学家对它们的进一步发展,对它们毁灭力的担忧,已经不是说能够炸伤多少人,炸死多少人,对它的安全性的担忧,本身就是它能不能灭绝人类。

已经到了这样的时候,虽然它现在还不能够灭绝人类,但是它已经接近灭绝人类的能力。而且时间是在加速的,将来只会越快,不会更慢。这是我论证的第二步。

论证的第三步,就是只要科学技术还在失控发展,手段的毁灭力一定会更大,直至灭绝级手段的出现。

这是个什么道理呢?就是从量变到质变的过程。

即使我们今天担忧的核子技术、基因工程、纳米技术、人工智能,都不能够灭绝人类。但是,只要科学技术还在往前发展,就一定会出来一个更厉害的东西。而这个更厉害的东西,早晚具备灭绝人类的能力。

而且,当最早的灭绝技术出现之后,会有新的灭绝技术又出来。这个新的灭绝技术,会越来越趋向于某个企业也能获得,甚至科学家个人都能获得。一个国家的行为还好控制一些,人类个体的行为是很难控制的,有那些敢于干极端坏事的人。

第四步,就是灭绝手段不可抵消,也就是那无法防御。

有些手段它是不能抵消的。比如核武器,核能爆发之后,它爆发就爆发了,造成死伤就造成了死伤,你不可能抵消核能,没有发现这个东西。

有些可以抵消,比如释放病毒导致瘟疫,可以研制出相应的药物来治疗,这个可以抵效。但是,即使能够抵消,任何一种灭绝手段的反制措施,都需要一个研制的时间,需要一个过程。人类在这个时间差内,将暴露于灭绝危机的威胁之中。

随着灭绝手段越来越多,这种手段种类的叠加,人类的未来又极其漫长,使得这一窗口期将被无限放大。即使能够抵消,甚至核武器可能将来也会抵消,但总有一个研究抵消的过程。

由于时间长,纯粹没有抵消的时间段也会很长,窗口期也就很长,使得人类就在很长的时间里面,暴露在既有灭绝手段威胁,又没有解决手段的这么一个环境中间,时间一长,早晚会出事。

这就是我的防御极限测试。也就是假设都能抵消,也有一个研究过程。

这是我论证的第四步。

论证的第五步是什么呢?(指着PPT)灭绝力量的爆发不可避免。

科学技术具有不可确定性,我们常常认为好的东西,它恰恰是最坏的。而且人性恶的一面,会导致任何时候都有寻求干极端坏事的人。哪个年代都有干极端坏事的。当科技发展到灭绝人类的层级之后,灭绝力量一定会爆发。其爆发的途径有三个。

第一个,极端手段会被极端的坏人恶意的使用。

第二个,实验室的不慎,有可能导致灭绝力量的爆发。因为灭绝手段都是高端技术,高端技术不可确定性就更强。我们的科学研究都是在探索未知领域,既然是探索未知领域,就有不知道的东西。当科学技术达到很高高度的时候,不知道的东西中说不定会蹦出一个怪物来,把人类给灭了。这是第二个途径。

第三个途径,就是科技产品的不慎使用。

很多科技产品,如氟利昂,开始认为很好,结果使用以后,导致臭氧破坏。这种情况将来会越来越多。

综上所述,我们通过这五步论证,就实现了我的灭绝路径分析+防御极限测试。

路径分析,(指着PPT)就是这样的路径。

防御极限,(指着PPT)我就假设所有的手段都有抵消的办法,但是研究它的抵消办法也有个时间,而且人类的未来又很长,导致不能抵消的窗口期变得很长。而我们人类的整体生存又无与伦比的重要。

所以在处理这个问题的时候,不仅是一个简单结论问题,还有一个决策逻辑的问题,科学技术不能再往前走了!

你教授您看,我们是先讨论,还是先往下讲?

莱维特:

总体来说您的观点,我都是认可的。

比如说像技术,它是存在一定的危险性,未来也存在一定危险性。可未来是未知的,我们知道人类的灭绝在未来有可能是因为技术这个因素所引起的。但也有可能是因为其他的因素引起的。比如说自然的力量是非常重要的因素。所以灭绝的可能性在未来也有可能来自于自然。

四、人类灭绝的自然威胁

胡家奇:

我对人类灭绝的论证,其实是分成了两部分。我这次只是讲科技灭绝人类这一部分,我对于自然对人类的灭绝,也用大量的篇幅,大概是用了二十万字的篇幅,研究自然对人类的灭绝。

我把自然对人类的灭绝,分成了这么几个级别:

第一个级别是宇宙级别。宇宙级别,人类逃不过的灭绝:比如宇宙的终结,宇宙终结是人类逃不过的一个劫。不可能逃过宇宙的终结,这是一个定论。

第二个,比如黑洞的吸噬,超新星爆发,还有微黑洞可能吸噬,还有独立行星撞击,还有外星人的入侵,这是宇宙级别的危险。

我得出的结论是,这些威胁要么就是许多许多亿年之后的事情,要么就是概率极小极小的事情,小到可以忽略,

这是宇宙级别的事情。

第二个级别,是太阳系级别的威胁。

我们有一个是逃不掉的,就是太阳在五十亿年以后,会变为红巨星。它会猛的膨胀,人类躲不过。只要不移民出太阳系,就躲不过这个灾难。

第二个,大的小行星撞击。但是这个大的小行星撞击,概率是非常小的。

现在通常的观点是一颗直径十公里的小行星,撞击了墨西哥的尤卡坦半岛,导致了恐龙的灭绝。但是我相信那颗十公里的小行星有可能灭绝恐龙,但灭绝不了人类。

因为人类的生存能力远远高于恐龙。人类不是赤身裸体面对自然气候,也不是简单的获取食物,而是创造性的获取食物。所以一般的小行星撞击,不可能把人类灭绝。一颗直径一百公里以上的小行星撞击地球,甚至我都认为它灭绝不了人类。

有人预测,直径十公里的小行星撞击地球的概率是一亿年一遇,那么,直径一百公里的小行星撞击地球的概率,那就是好多亿年才发生一次的事情。

在太阳系级别方面之内的,还有一些其他的因素,比如太阳自身的活动,如太阳黑子的活动、还有磁暴等,但它们都灭绝不了人类。

所以,扫视太阳级别的威胁,要么是刚才说的许多亿年以后的事,要么就是概率极小的事,要么就是不能够灭绝。因此,对于太阳系级别的威胁不必那么担忧。这是我分析的第二个方面。

第三个就是地球级别的危险。

比如在地球上有超级火山,有超级地震。在历史上有整个海洋被污染,有几次灭绝是海洋污染导致的。还有地球气候变化的极值,热的时候,两极的冰雪都融化,冷的时候,赤道附近都有冰雪。以及地球磁极的反转,会导致地球磁场短期消失,地球生物会少了一道拦截宇宙射线的屏障等等。

但是所有这些东西都不足以灭绝人类,可能会死伤很多人,但是不足以灭绝人类。因为人类的生存能力太强。我们用各种科技手段都能够培养出食物,哪怕北极圈,在温室里也可以培养出食物。所以它可能会导致很多人死亡,但是不能够导致人类灭绝。

这是在地球级别方面的威胁。

第四个还有进化规律、生物方面的威胁。

比如超级病毒,超级细菌,人类自身也有可能退化。这些有可能会使很多人死去,但是它不能导致人类灭绝。我对人类灭绝的定义是一个人都不剩。

综上所述,结论就是自然的力量要灭绝人类,要么是亿万年之后的事,要么就是概率极低的事,低到都完全可以忽略。

五、人类灭绝的自身威胁

胡家奇:

第二个方面就是人类自身的威胁。

关于人类自身的威胁我也做了很多分析,科学技术只是一个因素,但是,正是这个因素,它成了一个决定性的因素。所有的因素和这个因素比都不值一提,它的权重太大。它对人类的灭绝长则两三百年,短则就在本世纪。

就像辛顿说,四十年之内人工智能失控的可能性有百分之二三十。这个百分之二三十是低还是高啊?人类的整体生存无与伦比的重要,人类的整体生存高于一切,它是一个无限大,一个无限大乘上百分之二三十,还是无限大。这是辛顿说的,辛顿是生成式人工智能方面的老大,这是他自己说的。

作为一个决策者,这就不是一个科学问题了,这是个决策的的哲学问题。在面对百分之二三十有可能灭绝人类的情况下,如果你做决定,是停顿还是发展它?只有四十年时间。

我刚才说到,托比·奥德这个牛津的哲学家,说一百年内,科技灭绝人类的可能性是六分之一,也就是百分之十六。我不知道他怎么算出来的。但是把这个问题算出来之后,你是不是有种恐惧感呢?百分之十六是非常大,因为百分之十六乘无穷大约等于无穷大,还能往前走吗?

教授,您有任何问题都可以打断我。

六、关于限制科技发展的讨论

莱维特:

(指着莱维特自己划的轴线)两百万年前,人类诞生了。这是时间线(横轴),从两百万年前一直到现在。而这条轴(纵轴)代表文明的进步、人口的增长、技术的发展。有些人类物种已经灭绝了:尼安德特人等等,这是历史。我们可以问一个问题:智人灭绝的可能性有多大?在早期,灭绝是很容易的,因为技术落后,人口稀少。我们也可以看看物种是如何走向灭绝的。在农业出现之前,在家畜驯化之前,这是技术开始发展的起点——农业、家畜驯化等等。技术的发展让人们在小行星撞击、火山爆发之后更容易存活下来。有了农业,人口增多了,技术的发展也使得他们更难被灭绝。

现在我想问胡先生一个问题:如果你能回到过去,并且停止技术的发展,你会选择在哪个时间点停下来?

胡家奇:

好,那我来回答这个问题。

人类在早期非常脆弱,在应对自然的时候他们的脆弱体现在两个方面。第一个 ,人群太少;第二个,他应对自然的能力太弱。

当人类,我指的是智人。现在说智人进化完成是什么时候 ,还有些争议,但是普遍认为智人完成进化是一二十万年之前。

当时我写这本书的时候(指的是《拯救人类》一书),只写了五六万年前智人完成进化。因为我当时所获得的资料就是六万年。今年已经是写完了第二十个年头了。那么这二十年来,有很多的发现,有很多的考古发掘,时间往前推了,新的时间推论是智人完成进化是一二十万年。

智人完成进化是一二十万年前,一万年前左右进入到农业文明时期。进入到农业文明时期,是以动物能够驯养、植物能够驯化为前提的。

那么考古学家发现了一个现象,就是在人类定居下来,进入农业文明之前大几千年,就有了进入农业文明的能力。那时的人类智慧没有问题,而且也能够驯养出来一些动物,也能够驯化出来一些植物。

所以在人类进入农业文明之前的好几千年,那时的人类就已经有能力进入农业文明了。为什么他们迟迟不进入农业文明呢?

这就是斯塔夫里阿诺斯的一个观点,刚才我说的这个证据,他是引用了两位美国很有名的考古学家考古的结论。斯塔夫里阿诺斯的解释是,那个时候人类虽然是旧石器时代,但是他们有足够的食物,而且能够享受很休闲的时光。他认为那个时候人类的休闲时光比现在的考古学家还要多。

那个时候的人类不为食物操心,这种不为食物操心的程度比现在还要优越。我是经历过文化大革命的,当时饿得要死。

斯塔夫里阿诺斯在他的《全球通史》中明确阐述了这些,其他历史学家也谈到过这个问题。

其实这个就是我要谈的第二个问题,我今天就不跟您讨论这第二个问题了,因为第一个问题都不一定讨论得完。

开始我介绍了,我的研究是由两个点切入的。第一个问题是人类的整体生存问题;第二个问题是人类的普遍幸福,科学技术创造了无尽的财富,却没有给人类带来普遍幸福。假如将来有机会的话,我们还可以讨论第二个问题。今天我们仅仅只讨论第一个问题。

下面我回答您的提问:

当人类进入到农业文明时期以后,自然的力量就很难把人类灭绝了。原因如下:

第一个,是人类的种群更大了。

第二个,人类已经能够创造性的获得很多食物。

当一般的自然力量灭绝不了人类时,人类的主要威胁就来源于自己了。

莱维特:

如果我们在这个节点停止科技,反而会增加灭绝的风险。这种灭绝可能来自地球的威胁。就像你说的那样,还有来自太阳系的威胁,还有来自宇宙的威胁。也许我们展望未来,还会有其他的危险。如果我们在前期就停止技术发展,我们反而会更容易灭绝,而不是更难灭绝。

胡家奇:

好,我来回答您的问题。

其实人类进入农业文明时期以后,第一个,我们人类自身灭绝不了自己,我们的手段太原始,

冷兵器时代一刀一箭才能杀伤一个人,想灭绝都灭绝不了。

莱维特:

我的意思是,五世纪的那场瘟疫,病毒杀死了百分之五十的人口。我们人类差点就灭绝了,能活下来真是万幸。

胡家奇:

关于这个问题,可能我跟您有一些不太相同的观点。我觉得瘟疫,它和人口的密度很有关系。比如,十四世纪时候欧洲的黑死病,大量的欧洲人死亡,但是犹太人躲过了那个瘟疫。因为犹太人在自己独立的空间里面,和其他人交往很少,能够保证自己这个空间里面很卫生,管理得很好,所以犹太人躲过了黑死病,其他欧洲人就没躲过黑死病。

所以不管是瘟疫,无论是细菌还是病毒,它的传播都和人口密度很有关系。在自然状态下产生的瘟疫,说到极点,把人类灭掉了百分之九十九,也还有百分之一能生存下来。

因为我有一个定义,我这里讲的灭绝是一个人都不剩,人类没有再来的可能性,我的书中就有这个定义。就像恐龙一样没了,当它们一个都没有的时候,这个物种也就没有未来了。

比如中国有一个时期,就是那个东晋十六国时期,中国北方的人口死了多少?死了百分之七八十,剩下来的只有百分之二三十了。主要是杀戮。

你知道两脚羊吗?当没有军粮的时候,这一万人就是你的军粮。老百姓就被吃了。还有口味问题,小孩好吃,女人好吃,再就是男人,再最后吃老人,老人最不好吃。

中国历史上有两个这个阶段,一个是东晋十六国阶段,还有一个是五代十国这个阶段,这两个阶段是中国历史上最残酷的阶段。那真是人吃人,没有军粮的时候,就分配人来吃。

莱维特:

这是哪一年的事情?哪个朝代?

胡家奇:

五代十国就是唐和宋之间。但是那还不是最厉害的,最厉害的是东晋十六国的北方。中国的北方就是这么惨。

莱维特:

这是哪一年的事情?哪个朝代?

胡家奇:

大约公元300年到430年之间,是中国历史上最黑暗的时期。这一段时间,一百年多年,人口减少百分之七八十。

瘟疫会随着人口密度的减少失去传播途径。就像几年前的新冠肺炎一样,为什么要隔绝?就是不能让人活动。

瘟疫的停止有三种可能性:第一种可能性,它能够产生群体免疫。第二种可能性,当密度变小了以后,密度低了以后,它也会停止。第三个就是产生了治疗的药物。

所以瘟疫不可能无限的传播,除非有特别设计,它不可能无限地杀死人类。当传播的密度非常低的时候,它就没有杀死人类的功能了。这是关于瘟疫的问题。

七、限制科技发展的最佳时间点

莱维特:

(指着自己划的轴线)如果我们要将科技停下来,如果文明在这里(指的是石器时代)停滞不前,那将是糟糕的。

胡家奇:

其实我不主张文明在这个地方停止。假如我是那个时候的人,我会有幸福感。但是我走到今天以后,我不要回去。道理在哪个地方?因为这个时候的人类是非常辛苦的,虽然横向比较比其他动物过得好,但与现代人类无法比较。

莱维特:

后面会发生什么,我们其实也不知道。

胡家奇:

这个就是我刚才说的,要推演。科技能否灭绝人类无法证伪。

莱维特:

我同意。但还有一种可能性,就是存在某种非人类的技术,如果我们不发展自己的技术,它就会毁灭人类。您读过《三体》这本书吗?那本科幻小说。通过来自另一个文明的威胁所构成的网络,他们需要发展技术来对抗这种威胁。如果我们停止技术发展,会发生什么呢?我不知道。

胡家奇:

《三体》的书我看过,还有电视剧,我都看过。这是中国作家刘慈欣写的。它具有强烈的科幻色彩。我觉得我是在搞科学研究,我不是搞科幻设想。

莱维特:

您也讨论很多关于幸福的问题。

胡家奇:

教授,我还想接着把这个话说完,把我的观点表达完。我认为,人类假如能够停留在两百年前就好了。差不多吧,两百年前就挺好的。两百年前的科技水平如果广泛普及全球,人类能够很好的解决丰衣足食的问题,

很长一段时间,虽然进入了农业文明,但是没有真正解决吃饭问题。只有到工业革命之后,生产力大幅的爆发,那些生产力和比较简单的工具有关系,和直观感受的生产力有关系。越隐蔽的越容易把人类杀伤。越不隐蔽的,越能直观感觉到的,就好利用它。

所以我认为工业革命之后五十年是最佳的科技限制点。如果将那时的科技普及到全球,既能解决了人类的吃饭问题、穿衣问题。同时,又距离灭绝人类的科技水平有足够的安全距离。

我觉得有灭绝人类的这种可能性的出现,有一个关键的时间点,就是在爱因斯坦的质能方程提出来之后,人们发现科学技术里面的能量太大了,但是我们不能采用爱因斯坦一九零五年那个时间(指质能方程提出的时间)作为限制科技发展的节点。我们得往前推,应该留足安全的刹车距离。

没有百分之百准确的限制科技发展的最佳时间点,我更愿意把它定在工业革命后五十年就可以了。那个时候人们既能解决吃饭问题,也能解决穿衣问题,和以前的生活比还有幸福感,因为,幸福是在比较中产生的。而且非常安全,因为距离科技灭绝人类的层级还很远。

这就是我的结论。

莱维特:

像您说的那个时间节点,其实还是有很多的孩子,他们死于疾病,还有很多妇女,她们遭到不公平的对待,在那个时候有很多人,他们其实并不幸福。

胡家奇:

这个我同意。第一个,关于很多孩子病死,说明科学技术没有发展到那么高的层级。人类要想永续生存,是要做出一些牺牲的,如果不做出牺牲,想保证人类的永续生存是不可能的。这是第一点。

第二个,比如很多的妇女也没有得到公平的对待,这就是一个社会制度的问题了。对于社会制度的问题,那就是要用另外一种逻辑去讨论它。其实今天,全世界还有男女不公平的问题,这个问题到今天也没有完全解决。

就像美国的黑人,上世纪六十年代,林肯说解放黑奴都说了一百年,马丁·路德·金还在那里说《我有一个梦想》。我是想说,一个愿望,或者说一个制度从提出到完全实施有一个过程。

因此,这是另外一个问题,假如要讨论这个问题,就是要讨论第二个问题,也就是关于幸福的问题。这里我们是在讨论第一个问题,也就是人类的整体生存问题。

八、怎样才能限制科技发展

莱维特:

我们现在也可以换一个方向来讨论,假设我们是同意停止科技发展的,但是好像没有办法做到这一点。

胡家奇:

这个难度比较大,但是我有我的路径。

首先我要谈一个观点,就是人类政治实体的扩大是一个大趋势。

中国第一个朝代是夏朝,夏朝只是今天的山西省南部和河南省的西北部的一点点,商朝又大了一些,周朝又大一些了。秦始皇统一了中国,就更大了。全世界也是这个样子的。

你看今天中国十四亿人口,这么大的疆域,俄罗斯的疆域更大,还有原来的大英帝国。大英帝国的扩张、蒙古人的扩张都是这个道理。大英帝国当时好像全世界都是它的,当然它后面停止了,由于各种原因。

就是说人类政治实体的扩张,它是个大趋势,它有起有伏,有少的时候,有多的时候,现在就是一个降低的过程。但是很快我觉得就会增加。苏联崩溃了,这种情况是有的。但是总的来说,它是要扩大。

而阻止人类政治实体扩大的原因,我认为仅仅只有一个硬性条件,一个什么条件呢?我认为就是交通和通讯的不便,导致一个大区域无法治理,仅仅只有这么一个硬件条件阻止它的扩大。再没有第二个条件。

今天这段时间,它出现了一个停滞,和核武器的相互威慑有关系,和人们没有形成共识有关系。

只要形成了共识,人类的统一是有可能的。这个历史上有太多的例子,比如东德和西德,就自愿合并了。美国原来是十三个州,这十三个州是自愿合到一起的,它们都是自愿合并的。

所以,关键就是要把必须实现大统一的这个道理给全人类讲清楚。

莱维特:

您说到人类的群体会越来越大,这一点我是同意的。但是如果我们想阻止科技发展需要有一个实体去承担这个作用。比如说我们看,现在像中国和美国这样两个大的政治实体,

它们花多少年才能形成统一?比如五十年、一百年、三百年,这个我们是不知道的。但是只有形成这样的一个统一体之后,才有可能去限制科技发展,不然现在的科技竞争其实是非常激烈的。

胡家奇:

我觉得您说到了一个核心问题。这个问题现在我都不能够准确的回答。但是我们能够做这么个事情,它有利于这个事,也就是有益于促进大统一这个事情的实现。

一个什么事情呢?我们需要一次觉醒运动。

现在我们急需要一次全人类的觉醒运动,要把这个道理要跟大家讲清楚,如果人们对这个问题有了一个普遍的认识,就会形成多个统一的力量。

我举个例子,我随便可以设计几个方案,我觉得都可以促成人类的统一。假如,中国和美国在当今,在现在这个时候,认死了这个道理,中美两国加起来,就有百分之六七十的可能性把这个事情做成(指实现人类大统一),如果还加上俄罗斯,这个事情就变成了百分之七八十。如果再加上印度,这个事情就百分之八九十了。

你可以试想一下,中、美、俄、印度。印度人口最多,比中国人还要多。如果把这四个国家的工作做通,这个事情十有八九做得成,不是说肯定做得成,它也十有八九做得成。刚好这四个国家还连在一体。

你说这四个国家都同意了,谁还敢不同意呀?小国家是最愿意的,因为小国家老挨欺负,就像当时国联成立以后,谁都对它寄予厚望。

什么国家欢迎联合国?欢迎联合国的现在是五大常任理事国,因为它有特权。但是国际联盟不是,国际联盟没有这种一票否决制,所以最欢迎的就是小国。因为小国老被大国欺负,它不想老处于这样一种被欺负的环境。所以只要把这个觉醒运动搞好了,推动它不是个难事。

您对于西方的历史比我要清楚的多,因为我是东方人。历史上,有过文艺复兴运动时期,有过启蒙运动时期。没有文艺复兴运动,不可能有马丁的宗教改革,没有启蒙运动,就不可能有美国,美利坚合众国这个人类历史上第一个三权分立的民主政权,对不对?

所以我们需要觉醒启蒙,现在我们人类会,就是在干这个事情。我本人一直在干这个事。从十七岁一直做到现在,我跟那么多人写信,录了那么多的演讲,还想搞个首富,把我全部的钱搞进去了,就是搞这个事。

九、关于人工智能方面的讨论

莱维特:

现在我想换一个问题来问,我们现在处在AI高速发展的状态,在您看来,AI让实现人类统一变得更难还是更简单了?

胡家奇:

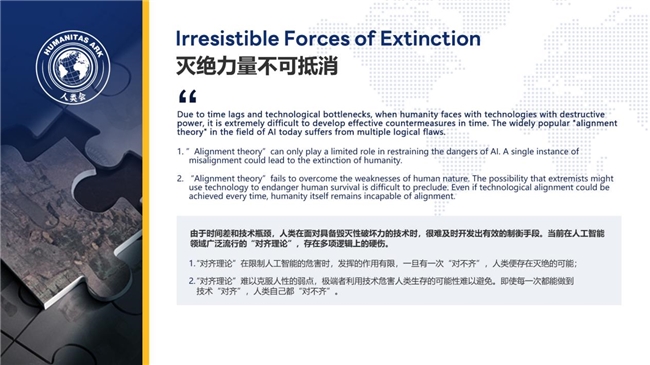

其实AI它是悬在我们头上的一把利剑,随时都有可能掉下来,AI发展太快了。尤德科夫斯基等人搞出来了一个“对齐理论”,还被好多人捧场,去认可。我对这个对齐理论很不以为然。

因为对齐理论目前是很热的,所以我要拿它来说说。对齐理论我认为这个产品能对齐,那个产品可能对不齐,所有的机器都能对齐,人类自己还对不齐。好多科学家故意干坏事,他有了那个(AI)工具,故意干坏事更方便了。

想毁灭全人类的有的是,他只是没有这个能力。当一个科学家有这个能力的时候,他想干这个事情(灭绝人类的事)的时候就很容易了。

所以我觉得这个对齐理论,你说它有没有用吧?还能够帮点小忙,但是帮不了大忙。所以,原来我认为尼克是我的知音,现在我都不认为他是我的知音了。

关于尼克·博斯特罗姆,这个我还可以给您看看(打开《拯救人类》一书)。我是1979年开始研究这个问题,一直研究到2007年,我的研究成果,就是这两本书。完成出版以后,我就想推广到全世界去了。

在推广的过程中就形成了两个极端,一个方面,有的人支持我。一个方面,绝大多数人反对我,还把我的书给封了。那个时候我要说科技灭绝人类,人家都说我是杞人忧天。

结果到了哪一年的?到了2013年,6年以后,我突然之间看到了一个报道,报道的是牛津大学人类未来研究所在尼克·博斯特罗姆主持下形成了一个报告。这是个正式报告,集中了很多科学家还有哲学家研究而成。

在这个报告中尼克说了一句话,他说人类最早在下个世纪灭绝,而灭绝人类的罪魁祸首就是科学技术。这句话说到我心里去了。

它是集中了很多科学家,还有哲学家,还有企业家研究形成的。他说人类最早在下个世纪被灭绝,灭绝人类的罪魁祸首就是科学技术。当时我看到高兴的不得了,于是我给他写了封信,还寄了本书(即《拯救人类》一书)给他。可是他没有回我的信,书应该是寄到了。因为他那个地方的工作人员到北京来的时候,专门拜访过我,只是他没有给我回信。而且我在杂志上和网上发表了一篇文章,叫《终于有了知音》,我认为他就是我的知音。

但是,过了这么多年以后,今天看来他不是我的知音。为什么他不是我的知音呢?第一,他今天说的话和他上次那个结论有区别。他说科技是否会灭绝人类具有“高度的不确定性”,这样一句“高度不确定性”,那就可以不用操那个心了。第二,他把对齐的理论引入到他们的研究中去了。我觉得对齐的理论就是个小技巧,有这个技巧不是坏事,但是它是对不齐的,永远对不齐。

他的对齐是个什么道理呢?我不知道教授是否研究过这个对齐理论,它是个什么意思呢?就是人工智能从现在的弱人工智能到强人工智能之后,人工智能就会有人类的思考能力了,它就会出现两个失误。

第一个,好心干坏事。比如你给了它一个指令,它也是在执行你的指令,但是好心干了坏事。举个例子,它认为要把这个地方的环境治理得特别好,可是人类是破坏环境的第一要素,它可能就把人类给灭绝了。

第二个,他担心什么东西?他担心人工智能发展到一定程度以后,它聪明的不得了,它一看你们人类怎么这么笨?“我一秒钟都能算出来的东西,你一千年都算不出来”,它就看不上人类了。高等物种鄙视低等物种,甚至把低等物种当做食物,这是大自然的铁律。所以它就会造反。

莱维特:

请让我问您一个问题:假设这是一个神奇的按钮,如果按了这个按钮,所有的AI都会被冻结,您会按吗?

胡家奇:

我会按,但是不可能有这个东西,这个东西不会产生。

莱维特:

如果假设它真的存在,您会按吗?

胡家奇:

我会按。因为我们的生活现在不需要它的话,我们也过得很好。其实很多人都向往桃花源式的生活。

十、关于未来世界的讨论

莱维特:

您刚才也提到了桃花源,但其实我们现在很多人之所以向往桃花源那样的生活,是因为他们并不真正了解那种生活。在那个年代,同样存在着可怕的疾病、苦难、奴隶制度、残酷的虐待,这些苦难是我们今天想象不到的。很多人觉得20年前、100年前甚至1000年前的生活更好,那只是因为我们只看到了那个时代好的一面,却无法想象当时那些不好的一面。

如果说AI的发展能够拯救人类,能够帮助我们实现理想中的桃花源,让全世界团结、让人们生活得更好,那也许是一件好事。但未来的事情谁也说不准,我们无法确定AI究竟会把人类带向何方,也无法确定现在就阻止它是不是正确的事。所以,首先就像您说的,现实中并不存在这样一个可以一键停止或一键实现的按钮。其次,我们之所以总想回到过去,恰恰是因为我们想象不到过去还有哪些苦难。

胡家奇:

好,我来回答这个问题。

我们从原始走到了今天,我们已经看到了今天很多好的东西,但是也看到了今天的问题。只是我们今天遇到了一个不得不解决的问题,就是人类有可能被科技很快灭绝。这个事情太大了,遇到这么大的问题,必须得解决它。只有相当程度地限制科学技术,才能够解决这个问题。所以我们今天的桃花源不是我们有意的选择,而是我们被迫选择,我们不得不这么做。

当然,未来的桃花源和过去的桃花源是不一样的。那是要把我们所有历史中认为最安全、最好的东西都融到桃花源里去,而不是只有牛耕田、只有马拉车。不是那样的桃花源。这就是我对未来的设计。

因为这不是我们今天的主题,本来我没把它当做是一个主要话题来谈的。既然谈到了这个地方,我就多谈两句,我们未来的社会,应该是个“平和、友好、均富的非竞争社会”。要把现有安全成熟的科学技术,广泛地普及到全球。我认为,把现有安全成熟的科学技术,广泛普及到全球,足可以保证全人类的丰衣足食。

这在中国的土地上都得到了验证。中国是十四亿多人口的大国,但是它的可耕地面积比美国少,比印度都少。印度只有中国国土面积的三分之一,但是它可耕地面积比中国多。而今天,中国都能够做到丰衣足食,因为中国有些农业技术是很不错的,这些农业技术都应该保留下来。还有一些对人类整体生存没有害的,比如说拖拉机耕田,联合收割机收割等,都可以保留下来。

所以,未来的桃花源和过去的桃花源是不一样的。过去的桃花源是没有经历过工业革命的桃花源。而今天,经历了工业革命的桃花源,可以摒弃那些坏的,留下来那些好的。所以它就足可以保证人类的丰衣足食。这是我们设计出来的,而不是被迫的选择。

十一、关于幸福问题的讨论

莱维特:

我对“什么能带来幸福”这个话题非常感兴趣。思考了很久之后,我明白了一件事:要获得幸福,你必须经历幸福、不幸、幸福、不幸这样的交替。因为如果只有幸福,那并不是一件好事。所以你需要幸福与不幸交替出现。只有这样,你才能拥有幸福的人生。这是我的看法,您怎么看?

胡家奇:

我对幸福有自己的定义,我特别同意您刚才说的,有时候幸福有时候不幸福。

我认为幸福是在追求中获得的,是在比较中产生的。如果一个人没有追求,他很难获得幸福。而没有比较,他也没有幸福感。比如,富人家里天天吃山珍海味,孩子就会没有胃口,而一个贫穷的农民家里偶尔吃一顿肉,他就觉得太好吃了。

那个比较是纵向比较,还有横向比较的问题。比如我看到别人家里面有豪华车,有豪宅住,

我只能蹬自行车上班,然后只能住很小的筒子楼,这个幸福感就差。所以幸福第一个是在追求中获得的。

第二个是在比较中产生幸福感。

而谈及追求,各个阶段的追求又不一样。比如在读书期间,我的追求就是尽量考个好成绩,然后能够考上一所好大学。大学毕业以后,我就希望能够分配一个好的工作。我现在这个阶段可能是还要养活自己的孩子,我希望自己的孩子有出息。假如我的孩子能够考上一个名牌大学,我也很幸福。

幸福是在追求中获得的,而每一个时刻都有多种追求,在追求什么时候的情况下,他会产生幸福感呢?

而在追求另外的一些东西,获得的不是幸福感,而只是快乐?

他是在对自己主要目标的追求中有所获得,才产生心理满足,这就有幸福感了。比如我最近已经失业了,心里很糟糕,就没有幸福感。但是,我在失业的状态下,我的朋友请我吃了一顿好吃的,还安慰了我几句。我在那一刻是开心的,是快乐的。但是这不是幸福。

所以,一共有两点:

第一点,幸福是在追求中产生的,而追求什么东西呢?是在追求你当时的主要目标的时候,有所收获而产生的。

第二点,幸福是在比较中产生的,可以和过去比较,还有和未来预期的比较,还有和周围人群的比较,在比较中间产生的。

为什么斯塔夫里阿诺斯说,今人的幸福感还不如旧石器时代的古人呢?因为那个时候的古人,可比较的内容和今天不一样。为什么呢?第一,他满眼看到的都是那些低等动物,包括那些老虎狮子都搞不赢人类。

因为人类设个陷阱就把它搞进去了。所以,他和所有动物比较的时候,他的幸福感就强。第二,他们有稳定的食物来源,还有很多休闲的时光。他们不需要总为食物的获得去拼命。他们觉得一天出去打一两只羊,就能够保证大家吃几天,他就有幸福感。那个时候他们并不知道有今天,如果知道有今天的话,幸福感就没有了。所以,幸福是波动的,幸福是在各个阶段追求他的主要目标的时候获得的。比如人老了,更多的是希望儿女孝敬,而年轻的时候有这样的条件也不一定幸福。还有就是,幸福是在比较中间产生的。这是我对幸福的体会。

(指着PPT)所以,我设计的未来的社会要做到幸福,它应该是个“平和”的社会,心里平和一些,别着急。人家今天吃肉,你只能啃骨头,你就着急,那是自己和自己过意不去。要“友好”,邻里之间友好相处,不要争斗。人类有永恒的争斗性。再就是“均富”。为什么要均富呢?一个贫富差距悬殊的社会,它一定是少数人的富有和多数人的贫穷混在一起,只有少数人幸福了,多数人心里就不幸福。仇富心理就是这么产生的,所以需要打造一个“均富”的社会。

(再次指着PPT)以及“非竞争的社会”。现在科学技术那么大的知识量,每天都有那么大的知识量逼着你去学习,逼着你去竞争。两口子加起来养不活一个孩子,都是相互比出来的。

所以,我认为一个“平和、友好、均富的非竞争社会”,它就是一个最能够让人产生幸福感的社会,也是一个最稳定的社会。由此,我认为大统一的社会是一个能够避免人类灭绝的社会,恰恰也是一个能够实现人类普遍幸福的社会。大统一社会相比于今天的国家社会,非常适合打造成一个“平和、友好、均富的非竞争社会”,因为,大统一社会没有了今天国家社会的残酷竞争,很多国家社会做不到的,那时候都能做。

十二、胡家奇介绍自己人类事业的奋斗历程

胡家奇:

我下面讲一下我这么多年的故事,我为什么这辈子要确定一个终身目标要干这个事情?

我是从农村走出来的,不知道有爱因斯坦。因为那个时候文化大革命,知识还很少。上了大学以后接触到很多前沿的科技,这些前沿的科技使我感到科技的威力太大了。在这种情况下,我觉得有个问题需要研究:科学技术发展有没有可能灭绝人类?什么时候灭绝人类?能不能拯救人类?我觉得这是一个很值得研究的问题。所以我就立了一个一辈子的目标。

毕业后,我的工作分配的很好,先在研究所工作,后来在国家机关工作,其他人可能都分到矿山去了,分到工厂去了。但是我就坚决要干这个事,也就是从事人类问题的研究。很幸运的是,我们单位就在国家图书馆不远,一有假期,我就往国家图书馆跑。但是,我觉得时间还是不够,我就下海。

下海以后,我是说我赚五十万就不干了,一心完成我的研究与写作,可是我下海的第一个月我就赚了一百多万,然后再过一年,我赚了超过一千万。那时候的一千万相当于现在多少钱啊?大概是现在的一千万美金。我下海的时候的工资只有186元,那相当于我几千年赚的钱。所以我很幸运,我觉得我自己有点经商的能力。

然后到了这个时候,我就把企业给别人干,让我的同事帮我干,他们现在都还在公司。我就完全是在家里写作了,在家里写了十年,其中有六年是完全脱产的。

写出来后(指《拯救人类》一书),我也想好好的宣传。像尼克·博斯特罗姆那样,我也找了好多的媒体宣传。结果媒体一宣传,不让我卖书了,把我的书给封了,那是二零零七年。

那怎么办?我就开始写信,给各个国家领导人写信,给科学家写信,把我的书寄给人家。这么多年发了十二次信,发了一百万封。其中邮件有八十来万封,纸质信件有二十来万封,寄出去的书有一万本。

中间,在二零零八年,我又建了个人网站,这个网站在网上一查就能查得到。这个网站是中英两种文字。但是因为我觉得在网上零散发东西还不行,我要有一个专门网站来推广。之后,随着人类会(原拯救人类行动组织)这个组织成立,我们又搞了一个网站。我们现在有两个专门的推广网站。我的个人网站有两种语言,中文和英文。人类会的组织网站有十几个语种,在全球推广。

我还在各个地方出书,在美国出了书,在俄罗斯出了书,在新加坡、香港都出了书。可是认可我的人太少了,推广的效果始终不理想,怎么办?

我决定要成为世界首富,因为,假如我成为世界首富,我说话就有分量了。就像马斯克,他说话就很有分量,他是世界首富。我把我的所有的钱都集中起来,搞了几个大的互联网项目:一路捞,一把一把捞,直接捞等。我的第一个网站是在人民大会堂搞的新闻发布会。仅仅一个产品发布会就花费了四百多万人民币。结果互联网搞了快十年。搞互联网太难了,它有个先入为主的问题。我的钱烧得差不多了,我就不能继续搞了。

既然首富的计划失败了,人类事业还得继续。我就搞个组织,也就是拯救人类行动组织,现在更名为人类会,我要用集体的力量来推动人类事业。那么这个组织现在就已经有一千三百多万的支持者。这就是我这些年所做的。

包括今天我们这次活动,也是新的一种方式,可能下个月还要约一位诺贝尔奖得主来,世界顶级的科学家要形成共识,我是这么想的。

十三、重要的观点吻合

胡家奇:

从1979年算起,我从事人类问题研究47年了,这个中间有一些和我观点一致吻合的地方。我刚才说的是我是2007年出的我的《拯救人类》一书。我在书中专门提出了外星人不能轻易接触,两年后,霍金提出来了同样一个问题。我为此还专门写了篇文章,叫《世界真是疯了》,发表在香港的《前哨》杂志上。

2013年,尼克·博斯特罗姆出了一个正式报告,就是人类将最早在下世纪灭绝,罪魁祸首就是科学技术,我当时专门写了一篇文章,叫《终于有了知音》。我还跟他写了信,给他寄了信,还给他寄了书,他没有回我,但是他那个地方的工作人员来北京的时候,拜访过我。

2014年,霍金说人工智能有可能失控并导致人类灭绝。霍金是在2014年十二月份说的,而这个事情比我晚了七年。

2017年,霍金在接受《伦敦时报》采访的时候说,我们可能要建立一个世界政府来进行监管。这个世界政府就是我们刚才说的人类大统一,他比我的观点刚好晚了十年。

当然,今天认可任何科学技术有可能灭绝人类的人越来越多了,但是还有两点,很少有人认可我的观点。哪两个观点呢?一个是必须要严格限制科学技术,将现有安全成熟的技术广泛普及到全球,足可以保证全人类的丰衣足食。第二个,人类必须实现大统一,用世界政权的力量掌控科学技术。

会员投稿

会员投稿 手机版

手机版 |

专家频道

|

专家频道